這幾天又出現一個火熱的新聞——《惡靈古堡》女主蜜拉·喬娃維琪與其協作者共同在 GitHub 釋出了「MemPalace」,中文翻譯為「記憶宮殿」。

這個專案主要在處理一個常見問題:LLM 在長對話或長期互動中,容易遺失上下文(context)。

MemPalace 採取的方式,和一般常見的「摘要記憶」不同,它偏向保留原始對話內容,再透過語意檢索把相關片段找回來使用。

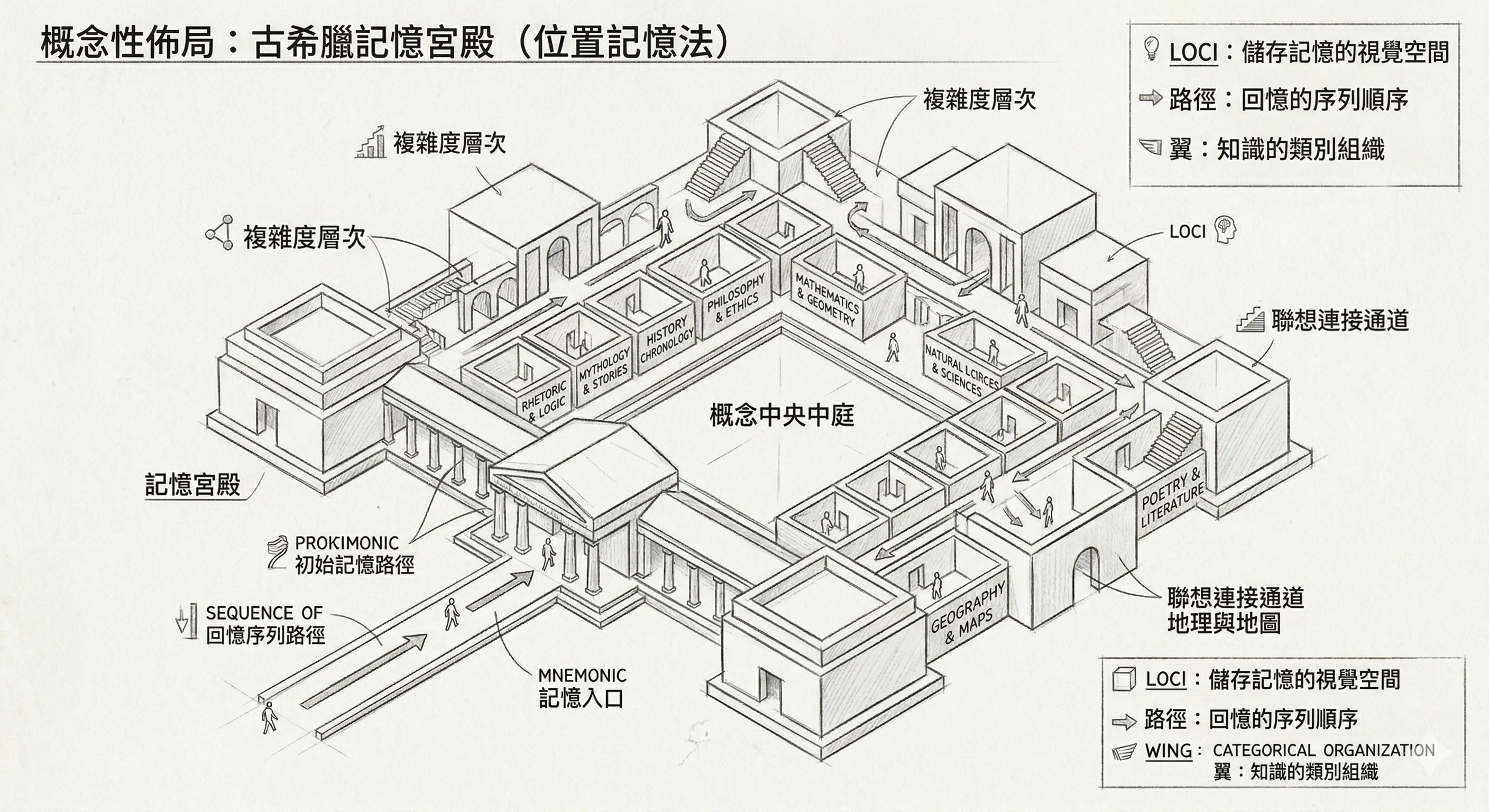

這樣的設計,其實對應到一個古老、源自希臘的記憶方法——「記憶宮殿(method of loci)」:

透過把資訊放在不同的空間位置(例如房間、走廊),在需要時沿著路徑取回記憶。

在這個專案中,則是用類似 wing / room 的結構來組織資料,再搭配向量檢索,讓 AI 可以在需要時找回相關內容。

它的核心其實很簡單——不是去「摘要記憶」,而是乾脆「保留全部原文」。這個選擇本身就很有意思,因為現在大多數 AI workflow 都是在想怎麼壓縮 context,但它是反過來:我不壓,我存,等需要時再找。

如果用工程的角度來看,這其實就是把問題從「compression」轉成「retrieval」。也就是說,瓶頸不在記憶,而在你能不能有效把正確片段「撈」回來。

不過這個專案最為吸睛的,反而並非獨創的關鍵技術,而是作者之一竟然是 Milla Jovovich——也就是《惡靈古堡》系列中「愛麗絲」的飾演者,同時也是《第五元素》等作品的知名影星。

根據專案相關說明,她在長期使用 ChatGPT、Claude 等工具時,發現 AI 無法延續過去對話的脈絡;而現有記憶工具又傾向替使用者篩選內容,可能丟失關鍵思考過程。這也促使她與開發者合作,嘗試建立一種能完整保留並可回溯的記憶系統。

目前這個專案已累積高達 30K stars,熱度仍在持續。不過因為它的 benchmark 看起來相當亮眼(甚至接近 100%),也引發部分社群的質疑與拆解,指出測試方式可能使結果偏向樂觀,且部分結果實際上依賴外部 API,與「完全本機」的說法並不完全一致。

不過值得一提的是,作者持續修正 README,將限制說明得更清楚,也讓數據呈現更為保守,讓整體專案逐步回到「可驗證」的軌道。

該專案基於 SQLite 與 ChromaDB,主要可在本地執行,不需額外 API Key(除非調用模型本身),因此在隱私與資料控制上具有一定優勢。

再觀察幾天,等更多評測與回饋出來後,再來決定是否實際安裝。(README 已說明支援多種 CLI 環境,並以 Claude Code 為主要整合對象。)